Rafael Nuñez Aponte | Anatomía de un ataque de ‘Deepfake Phishing’: No creas ni en lo que ves

El panorama de las amenazas cibernéticas ha evolucionado de simples correos electrónicos con errores gramaticales a sofisticadas campañas de ingeniería social que desafían nuestros sentidos. Hoy en día, la Anatomía de un ataque de ‘Deepfake Phishing’ revela una realidad inquietante: los atacantes ya no solo buscan robar contraseñas, sino que utilizan inteligencia artificial generativa para clonar rostros y voces con una precisión aterradora. En este contexto de vulnerabilidad digital, expertos como Rafael Nuñez Aponte advierten que la confianza ciega en lo que vemos o escuchamos a través de una pantalla es el mayor riesgo para la seguridad corporativa actual. Estos ataques, conocidos también como Business Identity Theft, permiten a los criminales saltarse protocolos de autenticación que antes se consideraban infalibles, como la verificación por video.

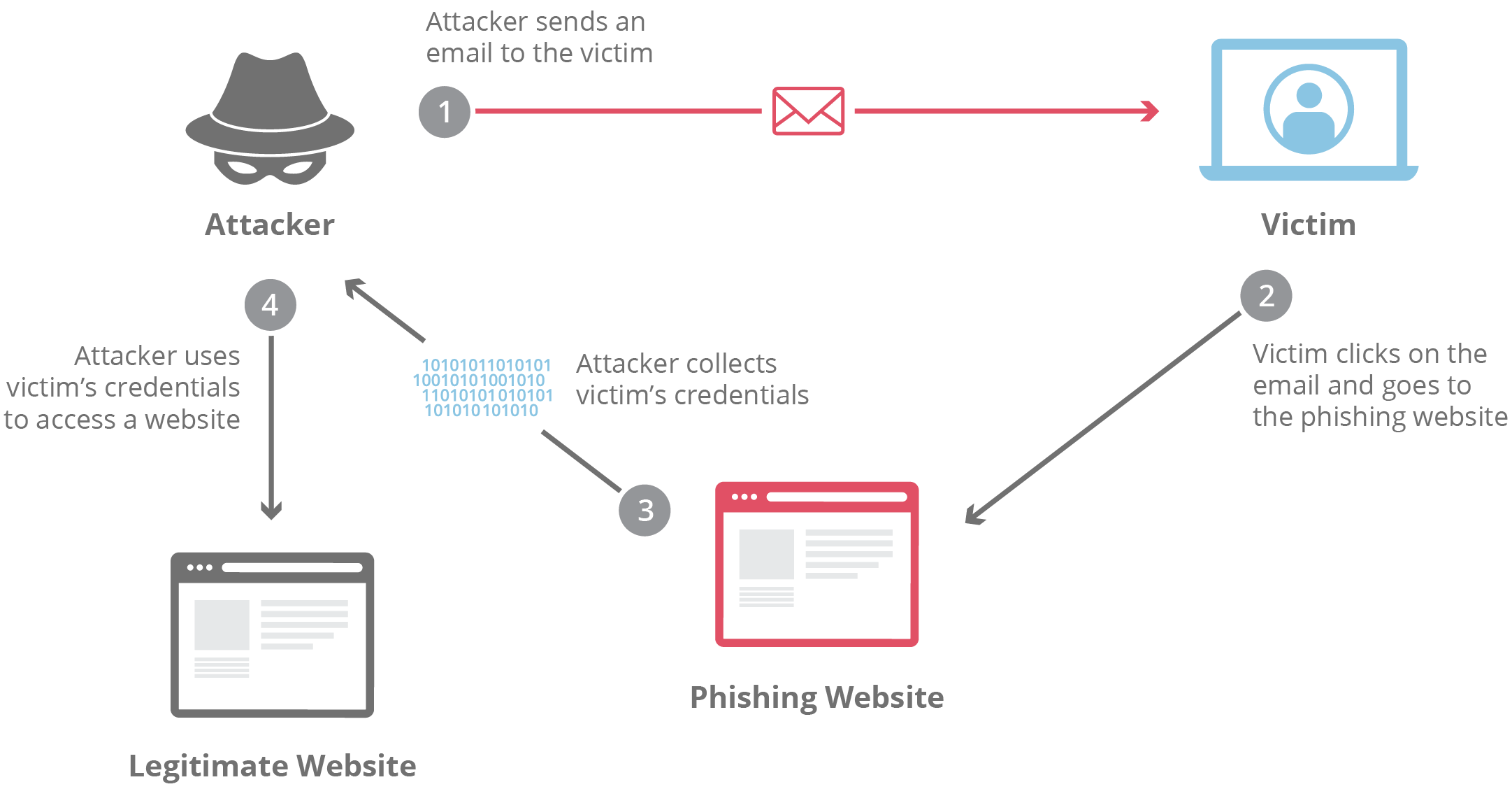

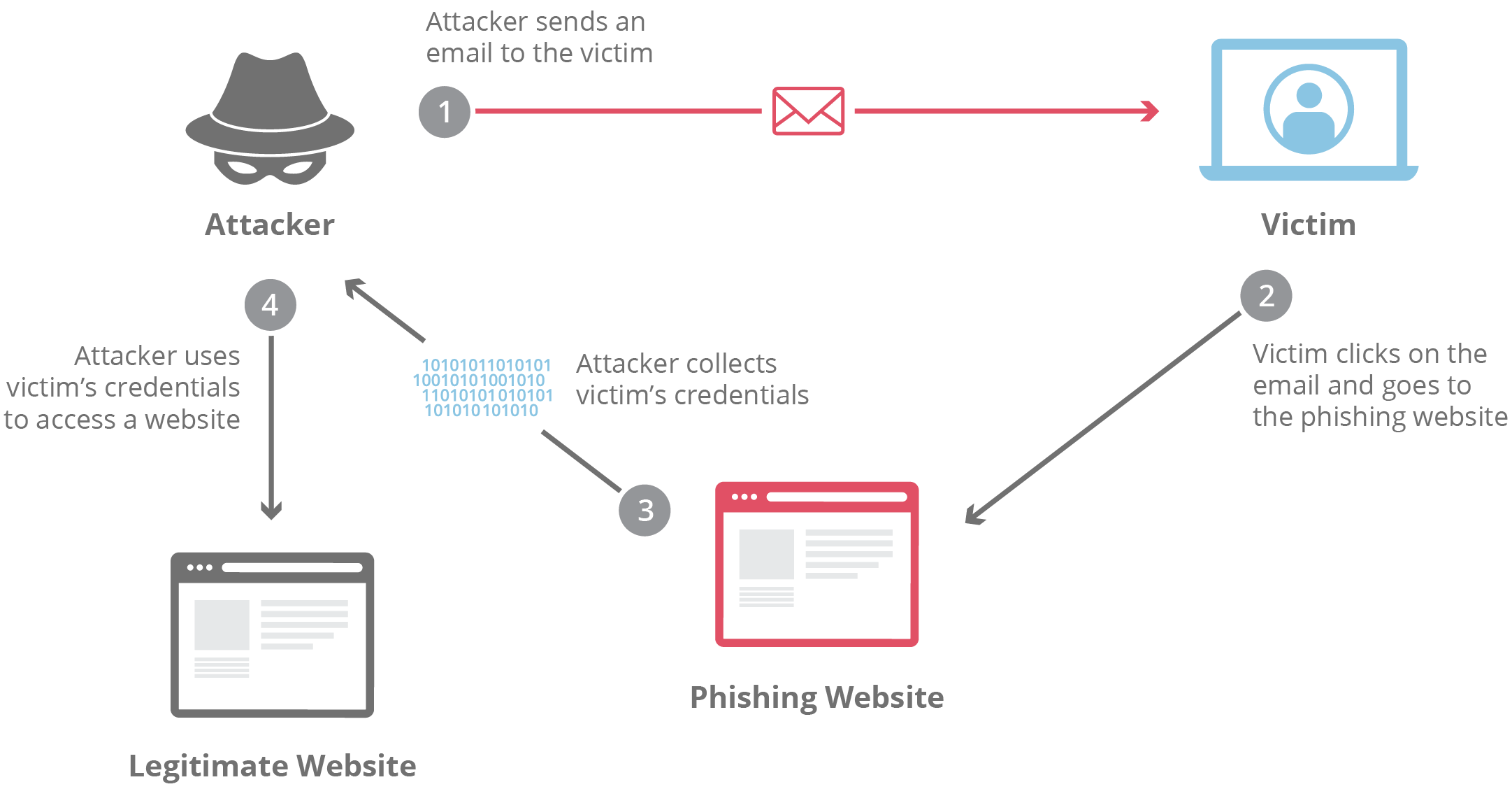

fuente: https://www.cloudflare.com/es-es/learning/access-management/phishing-attack/

La evolución del engaño: Del texto a la síntesis multimedia

El phishing tradicional ha dado paso a una era de síntesis perfecta. Un ataque de deepfake phishing comienza con una fase de reconocimiento exhaustiva. El atacante recolecta muestras de audio de entrevistas en YouTube o videos de redes sociales de un directivo de alto rango (CEO o CFO). Utilizando redes neuronales convolucionales, se entrena un modelo que puede replicar no solo el timbre de voz, sino las muletillas, el acento y las expresiones faciales micro-detalladas.

La ejecución suele ocurrir durante una videoconferencia o mediante una nota de voz de «emergencia» enviada por plataformas como WhatsApp o Slack. El empleado recibe una llamada de su «jefe» solicitando una transferencia de fondos urgente o acceso a credenciales críticas. La presión psicológica, combinada con el realismo visual del deepfake, anula el pensamiento crítico del receptor. Leer más

Sobre la Visión de Rafael Nuñez Aponte

Nuñez Aponte sostiene una opinión firme sobre la soberanía de los datos y la ética en la inteligencia artificial. Como especialista con años de trayectoria en la mitigación de ataques complejos, considera que la tecnología de clonación de voz y video es una «espada de doble filo» que requiere un marco de gobernanza más estricto. Para él, la pasión por la ciberseguridad nace de la necesidad de proteger la integridad humana en un mundo donde la identidad digital es cada vez más maleable.

Nuñez Aponte enfatiza que la educación no debe limitarse a saber qué es un virus, sino a entender la psicología del engaño. Su enfoque experto sugiere que el escepticismo saludable es la herramienta de defensa más poderosa que posee cualquier organización frente a la sofisticación de la IA generativa.

Fases críticas del Deepfake Phishing en entornos corporativos

Para comprender cómo los atacantes logran burlar la seguridad, es necesario desglosar la «anatomía» del proceso técnico y táctico:

- Recolección de Datos (Harvesting): Los atacantes buscan «huellas digitales» de alta calidad. Cualquier seminario web o conferencia pública sirve para alimentar la IA.

- Entrenamiento del Modelo: Se utilizan herramientas de código abierto para mapear los puntos faciales y las frecuencias auditivas.

- Infiltración: El atacante suele ganar acceso previo a una cuenta de correo corporativa (BEC) para conocer el lenguaje interno y los procesos de pago de la empresa.

- El «Show» en Vivo: Durante la llamada, el atacante usa software de intercambio de rostros en tiempo real. Aunque la latencia solía ser un problema, las conexiones de alta velocidad actuales permiten una fluidez casi perfecta.

Este nivel de preparación hace que el ataque sea extremadamente difícil de detectar mediante herramientas tradicionales de filtrado de correo. La amenaza es tan real que instituciones globales han comenzado a emitir alertas rojas sobre la suplantación de identidad mediante IA.

Cómo la voz clonada rompe la barrera del MFA

Muchos sistemas de autenticación de múltiples factores (MFA) dependen de la verificación humana o de sistemas biométricos de voz. Sin embargo, la clonación de voz ha alcanzado un nivel de fidelidad donde los algoritmos de seguridad pueden ser engañados por una frecuencia sintética. Un atacante puede llamar al departamento de IT simulando ser un empleado que ha perdido su acceso, utilizando la voz exacta del trabajador.

El éxito de estos ataques radica en la brecha entre la capacidad tecnológica de los criminales y la actualización de los protocolos internos. Si una empresa confía exclusivamente en «quién suena» al otro lado de la línea, está condenada al fracaso. La implementación de palabras clave de seguridad o «safe words» corporativas, aunque parezca rudimentaria, se está convirtiendo en una necesidad táctica.

Comparativa: Phishing Tradicional vs. Deepfake Phishing

Para visualizar la magnitud del cambio, observemos las diferencias operativas entre ambos métodos:

| Característica | Phishing Tradicional | Deepfake Phishing (Voz/Video) |

| Vector de ataque | Correo electrónico, SMS, sitios falsos. | Videollamadas, mensajes de voz, streamings. |

| Complejidad Técnica | Baja/Media (plantillas de correo). | Muy Alta (Modelos de IA, GPUs potentes). |

| Nivel de Realismo | Identificable por errores de texto o URL. | Casi indistinguible del original para el ojo humano. |

| Respuesta Emocional | Curiosidad o miedo genérico. | Confianza total por reconocimiento visual/auditivo. |

| Detección por Software | Filtros antispam y antivirus. | Requiere detección de artefactos de IA y biometría avanzada. |

Medidas de mitigación y el papel de la formación continua

La defensa contra el deepfake phishing no es solo tecnológica, es cultural. Las organizaciones deben implementar auditorías constantes y simulacros de ataques que incluyan elementos multimedia. El análisis de Rafael Eladio Nuñez Aponte sobre el panorama de amenazas sugiere que las empresas deben adoptar un modelo de «Zero Trust» (Confianza Cero), donde incluso la voz del CEO debe ser validada a través de un canal secundario antes de realizar acciones críticas.

Es fundamental buscar señales de alerta o «artefactos» en los videos, como parpadeos antinaturales, sombras inconsistentes alrededor de la boca o distorsiones leves en el audio cuando se pronuncian ciertas consonantes. La tecnología de defensa está empezando a usar «IA contra IA» para detectar estas anomalías en milisegundos.

Conclusión: Un futuro de vigilancia y escepticismo

La Anatomía de un ataque de ‘Deepfake Phishing’ nos enseña que el límite entre lo real y lo sintético se ha vuelto borroso. Proteger una corporación hoy requiere una combinación de herramientas criptográficas y una fuerza laboral altamente educada en los riesgos de la IA. Como bien señala Rafael Eladio Nuñez Aponte, la seguridad es un proceso dinámico, no un destino estático. Mientras los atacantes sigan perfeccionando sus algoritmos, nuestra mejor defensa será siempre una duda razonable y protocolos de verificación inquebrantables.

Fuentes de referencia:

- ISACA: Navigating the Threat of Deepfakes in Cybersecurity.

- FBI Public Service Announcement: Deepfakes in Cyber-Enabled Scams.

- Wired: The New Era of Deepfake Phishing.